Descubre cómo Sora, Veo y Grok están revolucionando la creación de videos con IA y averigua cuál es la mejor opción para tu proyecto digital.

La inteligencia artificial está transformando no solo la forma en que creamos imágenes y textos, sino también cómo producimos videos. En pocos meses, herramientas como Sora (OpenAI), Veo (Google DeepMind) y Grok (xAI) han redefinido el concepto de creación audiovisual, permitiendo que cualquier persona genere escenas realistas, guiones automatizados y videos completos solo con descripciones en texto.

Estas tecnologías inauguran una nueva era para el contenido digital, en la que la barrera entre la idea y la ejecución se vuelve casi invisible. Con Sora, es posible crear videos cinematográficos con audio sincronizado y un realismo físico impresionante; con Veo, dirigir producciones con control total de estilo, cámara y narrativa; y con Grok, planificar, investigar y guionizar utilizando una IA capaz de pensar, buscar y generar contenido en tiempo real.

En este artículo, entenderás cómo funciona cada una de estas inteligencias artificiales, cuáles son sus ventajas, limitaciones y aplicaciones reales, y descubrirás cuál de ellas tiene más sentido para tu proyecto, ya sea para crear contenido, educar, vender o automatizar la comunicación visual.

¿Qué es Sora (OpenAI)?

El Sora es el modelo de inteligencia artificial de OpenAI orientado a la generación de videos realistas a partir de texto e imagen. El objetivo de la empresa con Sora es enseñar a las IA a comprender el mundo físico en movimiento, transformando simples descripciones escritas en escenas coherentes, dinámicas y visualmente precisas.

Más que una herramienta creativa, Sora es parte de la visión de OpenAI de desarrollar modelos que entiendan y simulen la realidad, un paso más allá de los modelos de texto e imagen, y un avance directo hacia sistemas de IA multimodal completa.

En la práctica, Sora funciona como un “estudio de cine en tu bolsillo”, permitiendo generar videos cortos de alta calidad en pocos segundos, sin necesidad de cámaras, locaciones o edición compleja.

¿Cómo funciona Sora?

Sora utiliza un modelo generativo multimodal capaz de crear vídeos y sonidos sincronizados a partir de indicaciones en lenguaje natural.

Interpreta el texto del usuario, identifica el contexto, elementos visuales, iluminación, sonido ambiente e incluso la dinámica física de los objetos y personajes, asegurando que la escena generada cumpla con las leyes del mundo real.

La IA emplea modelos de difusión (diffusion models) combinados con aprendizaje por simulación física, lo que permite generar videos de hasta 60 segundos con movimientos naturales, sombras realistas y sonido ambiente integrado. La versión más reciente, Sora 2, añadió soporte para audio sincronizado, diálogos, efectos de sonido realistas y reproducción labial coherente con los personajes, acercando la experiencia a una película completa creada por IA.

Principales recursos y diferencias técnicas

- Videos de hasta 1 minuto de duración, en alta definición, con audio integrado.

- Fidelidad física realista: iluminación, reflejos y movimiento siguen leyes plausibles del mundo real.

- Varios estilos visuales: desde el cinematográfico hasta el de caricaturas o surrealista, en un solo modelo.

- Función Cameo: inserta la imagen y voz de una persona real (con consentimiento) en el video generado.

- App social integrado: la aplicación Sora combina feed, comentarios y remix de videos, como una red social de creaciones por IA.

- Interfaz simple: solo describe la escena; el modelo interpreta el contexto, tono y encuadre automáticamente.

- Seguridad y moderación: políticas activas contra el uso indebido, deepfakes y material sensible.

Estas diferencias hacen de Sora la herramienta más expresiva y accesible de OpenAI para creadores, uniendo creatividad y tecnología de forma fluida.

Casos de uso recomendados

Sora es recomendado para creadores de contenido, profesionales de marketing, diseñadores y educadores que buscan transformar ideas visuales en video rápidamente.

Algunos ejemplos prácticos incluyen:

- Storyboards y prototipos visuales para películas y campañas.

- Vídeos cortos para redes sociales con estética cinematográfica.

- Clases y simulaciones educativas, recreando contextos históricos o científicos.

- Anuncios conceptuales y teasers de producto.

- Experimentos artísticos y videos autorales en diferentes estilos visuales.

Como Sora permite generar resultados de alta calidad sin conocimiento técnico de filmación o edición, también ha atraído a creadores independientes y pequeñas empresas que desean profesionalizar su comunicación visual a bajo costo.

Actualizaciones recientes y roadmap

El Sora 2 fue lanzado en septiembre de 2025, marcando la segunda generación del modelo. Las principales evoluciones fueron:

- Inclusión de audio y habla sincronizada.

- Movimientos complejos más naturales (ej.: deportes, danzas, acrobacias).

- Mejora de la consistencia de personajes y objetos.

- Reducción de errores físicos (como sombras o colisiones irreales).

- Nuevo aplicativo móvil con recursos de creación y comunidad.

OpenAI ya ha confirmado que Sora se integrará a la API de OpenAI y a las versiones Pro de ChatGPT, permitiendo su uso directo en flujos de trabajo creativos. En la hoja de ruta, la empresa destaca planes para:

- Mayor duración de los vídeos;

- Edición dentro del propio prompt (agregar, cortar o cambiar detalles vía texto);

- Integración con Gator IA y DALL·E para pipelines visuales más completos;

- Herramientas de control ético y marca de agua digital.

Ventajas y limitaciones

El Sora destaca por reunir realismo físico y visual de altísimo nivel en una experiencia sencilla e intuitiva. Su capacidad de generar vídeos y audios completos en pocos segundos, con estética cinematográfica y variedad de estilos, lo sitúa por delante de la mayoría de las herramientas disponibles hoy. Esta combinación de potencia y accesibilidad lo convierte en una plataforma versátil para creadores y empresas que desean transformar ideas en escenas listas para usar, sin depender de grandes estructuras de producción.

Aun así, el modelo enfrenta desafíos naturales de una tecnología en expansión. El acceso sigue siendo limitado a ciertas regiones y usuarios invitados, y hay pequeñas imperfecciones en detalles finos, como movimientos de manos o expresiones faciales complejas. Además, el procesamiento intensivo requiere una infraestructura robusta, lo que impone restricciones de uso y alto costo computacional. Por razones éticas, Sora también adopta reglas estrictas de moderación, bloqueando la creación de contenidos sensibles o que involucren a figuras públicas sin consentimiento.

¿Qué es Veo (Google DeepMind)?

El Veo representa la incursión directa de Google DeepMind en el universo de la generación de videos por inteligencia artificial. Con él, Google busca no solo seguir, sino liderar el avance en contenidos visuales creados por IA. Lanzado en sus versiones iniciales en 2024 y evolucionando a la versión Veo 3 en 2025, Veo es parte de la estrategia de la empresa de ofrecer herramientas visuales de vanguardia para creadores, agencias, desarrolladores y marcas, reforzando la idea de que Google entrega IA escalable, crítica para producción, nube y marketing digital.

Cómo Veo genera videos y sonidos sincronizados

Veo utiliza un modelo de texto a video que acepta indicaciones en lenguaje natural (y, en algunas versiones, imágenes de referencia) y devuelve videos con audio nativo, incluyendo música, efectos de sonido, ruido ambiental e incluso diálogos sincronizados con los personajes. La versión Veo 3, por ejemplo, introdujo esta capacidad de generar audio alineado con la escena, lo que representa un avance significativo respecto a las IA anteriores que solo producían video mudo. La generación sigue un enfoque de difusión multimodal, combinando visión, sonido y movimiento, con soporte para variables como estilo visual, ángulo de cámara, iluminación y duración limitada (típicamente ~8 segundos en la versión actual) para garantizar la calidad de la renderización.

Herramientas de edición: Flow, Gemini y Vertex AI

Para hacer que Veo sea utilizable en flujos de trabajo creativos y empresariales, Google ha proporcionado interfaces que ayudan a controlar y editar el proceso de creación:

- Flow: es una plataforma de edición de video alimentada por IA que permite a los usuarios crear “clips cinematográficos” utilizando Veo, con características como la secuenciación de escenas, el uso de imágenes de referencia y ajustes de estilo.

- Gemini: dentro de la aplicación Gemini o a través de la API, es posible generar clips rápidos utilizando Veo 3, con indicaciones de texto o imagen.

- Vertex AI: para usos empresariales y de desarrolladores, Veo está disponible a través de Google Cloud (Vertex AI), permitiendo la integración en pipelines de producción y uso a escala.

Estas herramientas hacen que Veo no sea solo un modelo de generación aislado, sino parte de un flujo de trabajo completo de producción visual asistida por IA, algo muy alineado con las necesidades de marcas, agencias y creadores de contenido avanzados.

Recursos avanzados y diferencias técnicas

El Veo trae varios diferencias técnicas que merecen destacarse:

- Puede generar videos con alta fidelidad visual y audio sincronizado, acercándose a producciones cinematográficas.

- Soporte para entrada de imagen + texto: permite que el usuario proporcione una foto o ilustración como referencia y cree un video que evoluciona a partir de ella.

- Control de narrativa: el modelo reconoce comandos más complejos (ángulos de cámara, movimiento de personajes, transiciones), lo que le da más poder al creador.

- Compatible con APIs empresariales y nube, lo que facilita escala, integración y automatización para marcas y proyectos corporativos.

Aplicaciones prácticas y casos de uso

El Veo se puede aplicar en diversos campos:

- Producción de contenido en línea: videos cortos para redes sociales, teasers o clips promocionales donde el creador quiere un aspecto avanzado sin grabación tradicional.

- Marketing y publicidad: prototipado de escenas de anuncios, visualización de conceptos o preproducción de videos donde el tiempo y el costo son críticos.

- Educación y visualización: clases o explicaciones visuales donde recrear escenarios (históricos, científicos, culturales) con video puede aumentar el compromiso.

- Desarrollo de producto: visualizar modelos 3D, interfaces o experiencias de uso en video antes de prototipos físicos.

Estos usos son realistas dado que Veo permite generar escenas rápidamente, con audio, e integrables a flujos creativos existentes.

Ventajas y limitaciones

El Veo presenta ventajas claras: calidad de producción de vídeo+audio muy alta, control creativo significativo a través de Flow/Gemini, y fuerte integración con el ecosistema Google (alimentando marca, nube y APIs). Sin embargo, también lleva limitaciones relevantes: cada clip actual suele tener una duración corta (alrededor de 8 segundos) en las versiones disponibles comercialmente; el alto costo de uso (suscripción o créditos) puede obstaculizar a los usuarios más pequeños; los prompts muy genéricos todavía pueden generar una escena diferente a la esperada; y hay preocupaciones éticas, ya que algunos vídeos creados con Veo 3 se han utilizado para desinformación, planteando cuestiones de confianza y moderación.

¿Qué es Grok (xAI – Elon Musk)?

Grok fue anunciado como el chatbot de IA de xAI con una propuesta diferente: en lugar de actuar como una interfaz “moderna y filtrada”, nace con la filosofía de ser más directo, actualizado y menos “encajonado” por moderaciones estrictas. En palabras de la propia empresa, el modelo está inspirado en el libro The Hitchhiker’s Guide to the Galaxy, creado para responder “casi cualquier cosa” e incluso sugerir las preguntas correctas.

Desde su origen, Grok se posicionó como una alternativa a las IAs tradicionales que evitan temas “espinosos” o contexto en tiempo real, ofreciendo acceso directo a los datos de la plataforma X (anteriormente Twitter) y a la web, prometiendo respuestas más rápidas, más actualizadas y con “menos filtros”. Este enfoque “anti-filtro” atrajo a usuarios que quieren libertad de uso y acceso a temas poco explorados, pero también generó debates sobre moderación, responsabilidad y veracidad.

Cómo funciona Grok (búsqueda en tiempo real y razonamiento multimodal)

Técnicamente, Grok funciona como un modelo de lenguaje (LLM) que combina varias capacidades fundamentales:

- Acceso en tiempo real a la web y a la plataforma X, lo que permite que reaccione a noticias o tendencias emergentes, en lugar de depender únicamente de un conjunto de datos estático.

- Capacidad multimodal: además de texto, Grok acepta imágenes como entrada, realiza análisis de documentos largos y genera respuestas comparativamente sofisticadas.

- Arquitectura técnica moderna: utiliza frameworks como Kubernetes y JAX, y una arquitectura MoE (Mixture of Experts) que optimiza el rendimiento con un menor costo computacional.

Mediante esta combinación, Grok puede ser utilizado tanto para conversaciones simples como para tareas complejas de análisis, guion, código o síntesis de información.

Recursos e funcionalidades principais

Entre los recursos más notables de Grok se encuentran:

- Respuestas directas e inteligentes con tono sarcástico o “irreverente”, reflejando la personalidad que xAI quería para el modelo.

- Generación de imágenes (“Aurora”) y, más recientemente, funcionalidades que permiten video a partir de imágenes con sonido integrado (a través de la herramienta “Imagine”), aunque el enfoque principal sigue siendo chatbot/asistente.

- Modo “Think” o “Big Brain” que activa razonamientos más elaborados, orientados a tareas de programación, cálculos o análisis de documentos.

- Soporte a contexto extenso, resumiendo informes o varios documentos en una única respuesta.

- Integración con la plataforma X, lo que permite que capture tendencias, emociones y datos recientes de redes sociales para análisis en tiempo real.

Aplicaciones en la investigación, el guion y el análisis de contenido

Grok muestra una gran utilidad para los profesionales que trabajan con contenido, marketing o creación de video. Algunos ejemplos de aplicación:

- Investigación de mercado o tendencias: por su acceso a la web y redes en tiempo real, Grok puede ser utilizado para obtener insights rápidos sobre temas emergentes, competidores, lenguaje de audiencias o cambios de comportamiento.

- Guionización y brainstorming: al generar ideas, esbozar guiones o producir variaciones de Storyboard, Grok acelera el proceso creativo, funcionando como un “co-guionista digital”.

- Análisis de contenido y documentación: las empresas o equipos de producción pueden usar Grok para resumir informes, identificar puntos clave en documentos largos o combinar diferentes fuentes en una visión preparada para video o presentación.

- Preproducción de video: antes de generar el video en sí (a través de otra herramienta), Grok puede ayudar a construir un briefing visual, definir escenas, escribir descripciones detalladas e incluso sugerir variaciones de prompt.

Estas aplicaciones lo convierten en una herramienta complementaria valiosa para aquellos que manejan el flujo de producción de video, contenidos digitales o comunicación estratégica.

Ventajas y limitaciones

Grok se destaca por permitir la conexión con datos en tiempo real, análisis multimodal y automatización de tareas intelectuales, lo que es particularmente útil en flujos de trabajo de contenido, guiones y preproducción. Por otro lado, sus limitaciones son importantes: el modelo aún presenta errores factuales en algunas respuestas, su moderación ha sido criticada por inconsistencia y el uso libre o ilimitado está sujeto a planes de pago o restricciones de suscripción. Además, como herramienta reciente, aún no tiene un ecosistema tan maduro como los competidores más antiguos, lo que requiere que los usuarios realicen validaciones manuales de los resultados.

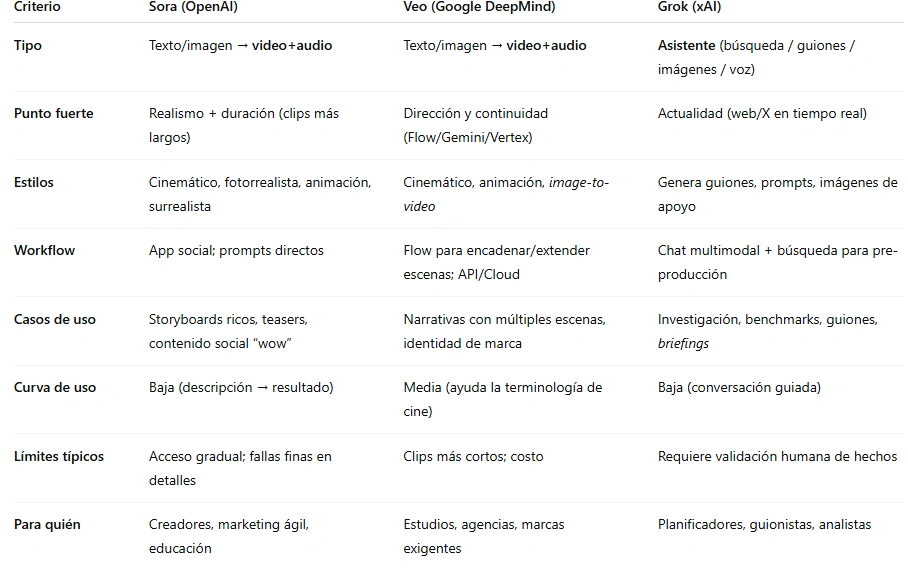

Comparación: Sora vs Veo vs Grok

- Sora (OpenAI): generador texto→vídeo+audio enfocado en realismo físico, variedad de estilos y clips más largos (hasta ~1 min). Ideal para impacto visual rápido y prototipado cinematográfico.

- Veo (Google DeepMind): generador texto/imagen→video+audio con énfasis en control de dirección (continuidad entre escenas, extensión/encadenamiento a través de Flow/Gemini/Vertex). Ideal para aquellos que necesitan “dirigir” la narrativa.

- Grok (xAI): asistente multimodal (texto, imagen, voz, web en tiempo real). No produce el video final: destaca en investigación, guión, briefings, variaciones de prompt y análisis competitivo para fundamentar la producción.

Tabela comparativa de recursos e casos de uso

Qué IA elegir para cada objetivo

- Impacto visual rápido / social / teaser: Sora.

- Historia con varias escenas y consistencia de personaje/ambiente: Veo.

- Investigación, agenda, guion, indicaciones y variaciones creativas antes de filmar/generar: Grok.

- Prototipado de anuncio + versiones dirigidas: Sora para concepto; Veo para versión final consistente.

- Educación y entrenamiento: Sora (ilustraciones visuales rápidas) o Veo (secuencias coherentes); Grok para materiales y cuestionarios.

Consejo práctico: Grok (planificar) → Sora/Veo (generar) → editor tradicional (finalizar).

Posibles integraciones entre ellas

- Grok + Sora: usar el Grok para briefings, sinopsis, listas de planes, tono de voz y transformarlo en indicaciones para que Sora genere clips de alto impacto.

- Grok + Veo (Flow): Grok crea un guion escena por escena, lista de tomas, referencias visuales; Veo/Flow encadena las escenas y mantiene la continuidad.

- Ciclo de iteración: Grok analiza resultados (retroalimentación estructurada), propone ajustes de indicación; Sora/Veo regeneran.

- Stack corporativo: Grok (investigación/competencia) → Veo a través de Vertex AI (pipeline) → DAM/edición (post-producción y distribución).

Puntos fuertes y débiles de cada IA

- Sora

- Fuertes: realismo físico; clips más largos; múltiples estilos; experiencia sencilla.

- Debiles: acceso gradual; eventuales artefactos finos; dependencia de capacidad computacional.

- Veo

- Fortalezas: control de dirección; continuidad entre escenas; integración Flow/Gemini/Vertex; API/Cloud para escala.

- Debilidades: clips más cortos por generación; costo/suscripción; requiere prompts más “cinematográficos”.

- Grok

- Fortalezas: web en tiempo real; excelente pre-producción (investigación, guión, variaciones); multimodalidad y automatización textual/analítica.

- Debilidades: no genera el vídeo final; necesita verificación de hechos y gobernanza de contenido.

Buenas prácticas y ética en el uso de IA de video

Las herramientas de generación de video con IA abren un nuevo horizonte creativo, pero también imponen desafíos éticos importantes. Uno de los puntos centrales es el derecho de imagen: cualquier reproducción de una persona real sin consentimiento puede configurar una violación legal, especialmente si la imagen se utiliza para fines comerciales o de manipulación de opinión. Lo mismo vale para obras protegidas por derechos de autor (músicas, marcas, escenarios, personajes, etc.).

Otro cuidado esencial es evitar el uso de la IA para generar deepfakes, videos falsos con apariencia real de individuos. Aunque las herramientas originales tengan filtros, el mal uso de modelos abiertos o modificados puede resultar en daños a la reputación y procesos judiciales. Siempre que sea posible, prioriza las creaciones propias y, al utilizar referencias visuales, asegúrate de que estén bajo licencias libres o de uso comercial.

Etiquetado y transparencia en el contenido generado por IA

La transparencia es uno de los pilares de la producción responsable con IA. Siempre que un video sea creado parcial o totalmente por inteligencia artificial, se recomienda identificarlo de manera clara, ya sea en el título, en la descripción o en los créditos. Esta práctica, adoptada por grandes plataformas y agencias, ayuda a construir confianza con el público y evita alegaciones de manipulación o engaño.

Algunas herramientas, como Sora y Veo, ya insertan metadatos o marca de agua digital indicando que el contenido fue generado por IA. Si el video se edita después de la generación, preserva esa información. Además, en contextos periodísticos, educativos o publicitarios, incluir una nota como “generado con apoyo de inteligencia artificial” refuerza la credibilidad y transparencia editorial.

Cómo garantizar la calidad y la credibilidad en las producciones

Generar vídeos con IA no es solo presionar un botón: es un proceso de curaduría creativa y técnica. Para garantizar calidad y confianza en el resultado:

- Planifica con propósito: define objetivo, público y tono antes de generar el video.

- Valida el contenido: revisa texto, audio y contexto visual para evitar distorsiones o informaciones incorrectas.

- Evita exageraciones realistas: cuanto más verosímil sea el video, mayor debe ser la transparencia en su origen.

- Incluya revisión humana: combine el poder de la IA con supervisión creativa y ética.

- Estandarice los flujos internos: cree políticas de uso de IA dentro de su empresa (licencias, derechos, verificación de imagen y sonido).

Producir con IA exige el mismo compromiso de calidad que una producción tradicional con la diferencia de que ahora la responsabilidad se comparte entre creadores y tecnología.

Conclusión

La nueva generación de inteligencias artificiales de video marca el comienzo de una revolución creativa. Cada una de ellas cumple un papel esencial dentro del ecosistema digital: el Sora, de OpenAI, expande los límites de la realidad y democratiza el cine virtual; el Veo, de Google DeepMind, transforma la dirección audiovisual en un proceso guiado por indicaciones e se integra a flujos profesionales; y el Grok, de xAI, actúa como cerebro analítico y creativo, conectando investigación, guión y automatización de contenido en tiempo real.

Más que reemplazar el trabajo humano, estas IA amplían el potencial de los creadores. Ofrecen velocidad, accesibilidad y precisión, pero exigen responsabilidad, curaduría y transparencia. El futuro de la producción de video no será solo técnico: será colaborativo, uniendo personas y algoritmos en procesos creativos híbridos y éticos.

Para aquellos que buscan participar en esta transformación, el secreto está en unir creatividad, conocimiento e infraestructura. Aquí es donde entra HostGator, ofreciendo las bases tecnológicas que hacen posible esta nueva era: servidores optimizados, automatizaciones con IA y herramientas como Gator IA que conectan sitio, marca y contenido.

Lo que antes requería cámaras, equipos y semanas de postproducción ahora puede nacer de una idea y evolucionar en minutos. El futuro de la creación de videos con IA ya ha comenzado, y está al alcance de quien sepa combinar imaginación con tecnología.

Consulta también:

- Cómo usar las redes sociales para alcanzar a tu público

- 10 sitios web de Inteligencia Artificial con recursos increíbles

- ¿Cómo aumentar el tiempo de la música en TikTok?

- Cómo crear un blog para tu negocio paso a paso: todo lo que necesitas saber y hacer

- AgentKit vs n8n: qual é a melhor opção para criar agentes de IA em 2025?